3월 마지막 주

3월 5째 주 ~ 4월 초반

읽은 논문

- How Much Position Information Do Convolutional Neural Networks Encode? (ICLR 2020 spotlight) [arXiv]

- TransGAN: Two Transformers Can Make One Strong GAN

- Generative Adversarial Transformers - https://arxiv.org/abs/2103.01209

- Training GANs with Stronger Augmentations via Contrastive Discriminator (https://arxiv.org/abs/2103.09742)

=> 4/5 밤까지 내용 정리해 놓을 예정

읽고 싶은 논문

계획을 조금 다르게 세우려 함. 분야별 읽을 논문 목록을 정리해두고 이 란에다가 쌓아 둔 뒤 하나씩 읽어보려 함. 제목은 한글로 정리할 예정. (노트제목은 제 메모장 제목들 입니다...)

기존 내용 접기/펼치기 버튼

글을 사진으로

노트 제목 : nlp 함치기 (03.16)

nlp 수업 듣다가 그냥 막 이것저것 합쳐서 그려봄. 구체화해보고 싶다면...

- CLIP: Connecting Text and Images https://arxiv.org/abs/2103.00020 블로그 https://openai.com/blog/clip/

사진 각도를 바꿔보자.

노트 제목 : gan회전(03.05) , 차원을 늘리면?(03.21)

gan 회전은 wgan 읽고 두가지 방식의 거리를 적절히 혼용해볼 생각을 했었음. 구에다가 맵핑 시키면 어떨까 하는 이야기가 나옴.

- Sphere Generative Adversarial Network Based on Geometric Moment Matching

- HoloGAN

차원을 늘리는 생각은 조금 더 구체화 해봐야 하지만 - Nerf, Nerf++. nerf-- 얘네랑 비슷한 개념. -> https://github.com/yj-uh/vi-lab/issues/26#issuecomment-792227996

- https://arxiv.org/abs/2103.07751 이것도 참고하자. Unsupervised Image Transformation Learning via Generative...

Contrastive랑 GAN이랑

Training GANs with Stronger Augmentations via Contrastive Discriminator (https://arxiv.org/abs/2103.09742)

중요 포인트를 태우자

노트 제목 : 패치 트랜스포머?

Vision Transformer (VIT) 보고 떠올림 이미지 패치로 넣는데 이걸 좀 다른 영역도 같이 넣어주면 좋을텐데... 라는 것임. 구체화된 생각 하나도 없음.

focus 된 convolution 관련 논문으로

- Deformable Convolutional Networks

AE 또는 VAE랑 GAN을 합치면?

노트제목 : 이게뭐람(03.19)

- introvae https://arxiv.org/abs/1807.06358

- adversarial autoencoder https://arxiv.org/abs/1511.05644

- bigan https://arxiv.org/abs/1605.09782

흑인 왜 없음

- Reliable Fidelity and Diversity Metrics for Generative Models

제대로 안읽어봤으니 읽어보자... - Extended Isolation Forest

분류를 이렇게도 할 수 있더라 읽어보자.

weight init & K-means

노트제목 : 갈무리되지 않은 생각들

추후 추가 예정.

구현한 논문

DCGAN

1 epoch

4 epoch

11 epoch

꽤나 잘 만들어내는 것을 확인할 수 있었다.

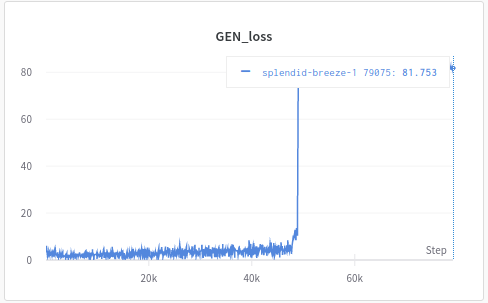

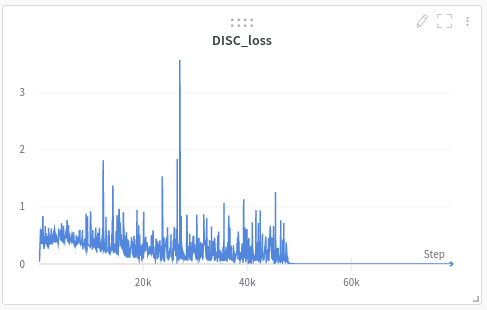

총 50 epochs를 돌려봤는데

Generate의 loss가 갑자기 늘어나는 것을 볼 수 있다.

Discriminate도 급격하게 줄어든다.

확인해보니 이런 이미지가 생성되어 있다.

Discriminate가 너무 뛰어난 성능을 보이기 시작한 무렵이 아닌가 싶다.

(code) - 구현 코드 저장 repo

구현중인 논문

Learning Not to Learn: Training Deep Neural Networks with Biased Data 나중에 구현하기로 함.

우리 세미나 task!!

(code) - 구현 코드 저장 repo

지난주 계획 체크

1주일간 해야할 일 우선순위 + 기한 별 나열. (괄호 내 기한)0. 위에 적힌 논문 목록중에 2개는 지워보자. 1개 지움1. 딥러닝 이론 과제...목표는 과제만 하는 것이 아니라 책도 읽어보는 것.(03-31 수)2. 자연어처리를 위한 딥러닝 수업 논문 살펴보기 (화)3. 딥러닝기반컴퓨터비전특론 수업 논문 살펴보기 (수, 목)

4. Learning Not to Learn: Training Deep Neural Networks with Biased Data 구현 (과제임) -> 못함5. 랩 코딩 해보기 (금)6. 랩세미나 논문 읽기 (금)

7. Color constancy 관련 연구 코드 한번 짜보기 (토, 일) -> 오늘 해야됨8. 운동 및 영어공부

9. 다음주 Weeklog는 시간 들여서 논문 정리도 해서 쓰기 + git 업데이트 하기 -> ...ㅎ

- 총 평

논문을 조금 더 많이 읽어야 할 것 같은 기분이 듬.

계획

1주일간 해야할 일 우선순위 + 기한 별 나열. (괄호 내 기한)

- 위에 적힌 논문 목록중에 2개는 지워보자.

- 자연어처리를 위한 딥러닝 수업 논문 살펴보기 (화)

- 딥러닝기반컴퓨터비전특론 수업 논문 살펴보기 (수, 목)

- 랩 코딩 해보기 (금)

- 랩세미나 논문 읽기 (금)

- Color constancy 관련 연구 코드 짜기 (토, 일)

- 운동 및 영어공부

- 다음주 Weeklog는 시간 들여서 논문 정리도 해서 쓰기 + git 업데이트 하기